Niebezpieczeństwa związane ze stosowaniem sztucznej inteligencji

Europol opublikował raport ostrzegający przed wykorzystywaniem narzędzia ChatGPT oraz innych generatywnych systemów sztucznej inteligencji do oszustw internetowych i innych cyberprzestępstw. Jak dotąd eksperci zidentyfikowali liczne przypadki nielegalnego użycia ChatGPT. Zdaniem Europolu zasady jego moderacji można obejść poprzez tzw. inżynierię podpowiedzi – praktykę polegającą na dostarczaniu danych wejściowych do modelu AI w celu uzyskania określonego wyniku. Szczególnie niebezpieczne mogą być praktyki phishingowe, podszywanie się pod mowę konkretnych osób oraz tworzenie kodu w różnych językach programowania.

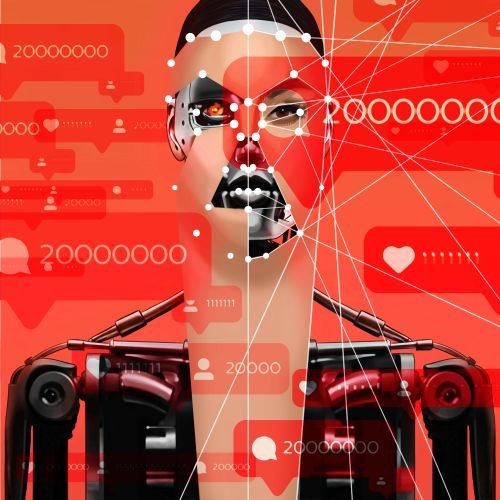

Jaką rolę odegra AI w kampaniach dezinformacyjnych i propagandowych? Może ona zmienić środowisko informacyjne do tego stopnia, że ludzie i maszyny nie zdołają odróżnić treści wygenerowanych przez sztuczną inteligencję od tych stworzonych przez człowieka. Programy AI mogą być także wykorzystywane do masowego manipulowania ludźmi za pośrednictwem chatbotów w celu dzielenia się teoriami spiskowymi i propagandą.

Zdaniem ekspertki AI Meredith Broussard rasizm, seksizm i ableizm zakodowane w programach opartych na sztucznej inteligencji nie zostaną wyeliminowane jedynie poprzez zastosowanie lepszych danych. Zmiana musi nastąpić w zachowaniach samego społeczeństwa. Np. algorytmy zatwierdzania kredytów hipotecznych są od 40 do 80% bardziej skłonne do odmowy udzielenia kredytu klientom o innym kolorze skóry niż biały. Zostały one przeszkolone na podstawie danych o udzielaniu kredytów hipotecznych w przeszłości.

dla Patronek i Patronów