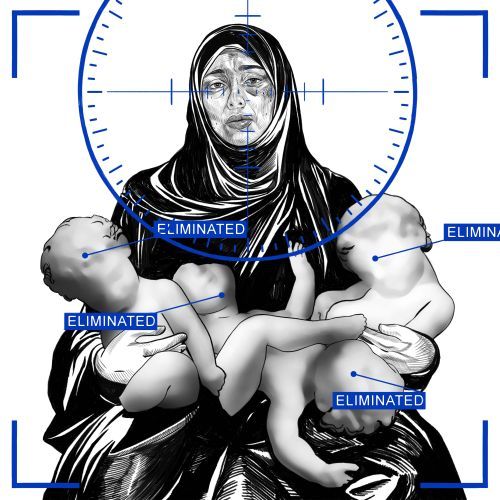

ChatGPT a zagrożenia dla systemu edukacji i reakcje nauczycieli

Oparty na sztucznej inteligencji ChatGPT rewolucjonizuje wiele branż, w tym środowisko akademickie. Zadebiutował już w literaturze naukowej – został uznany za autora co najmniej czterech artykułów i próbnych wydruków. Wydawcy z reguły są zgodni: AI nie spełnia kryteriów autora badania, ponieważ nie może brać odpowiedzialności za treść oraz integralność artykułów naukowych. Niektórzy twierdzą jednak, że wkład sztucznej inteligencji w pisanie artykułów można docenić w sekcjach innych niż lista autorów.

Tymczasem uczelnie przerabiają kursy i podejmują działania zapobiegawcze, aby studentom trudniej było korzystać z narzędzi opartych na sztucznej inteligencji. Pracownicy akademiccy wprowadzają zmiany, które obejmują więcej egzaminów ustnych, pracę w grupach i odręczne ocenianie. Uczelnie niechętnie jednak zakazują AI – ich władze wątpią, czy posunięcie to będzie skuteczne. Nie chcą zarazem naruszać wolności akademickiej. Uniwersytet Waszyngtona w St. Louis i Uniwersytet Vermontu opracowują poprawki do własnych zasad uczciwości akademickiej, aby ich definicje plagiatu obejmowały generatywną sztuczną inteligencję.

W szkołach nauczyciele próbują natomiast kontrolować, czy uczniowie używają chatbota do odrabiania lekcji, oraz zakazują korzystania z tego narzędzia na szkolnych urządzeniach i w sieciach wi-fi. Ponadto niektóre firmy, np. Turnitin, już aktywnie pracują nad narzędziami do wykrywania plagiatu ChatGPT, które mogą pomóc nauczycielom wyłapać zadania pisane przez sztuczną inteligencję.